Die besten KI-Code-Review-Tools in 2026: Automatisierte PR-Reviews im Vergleich

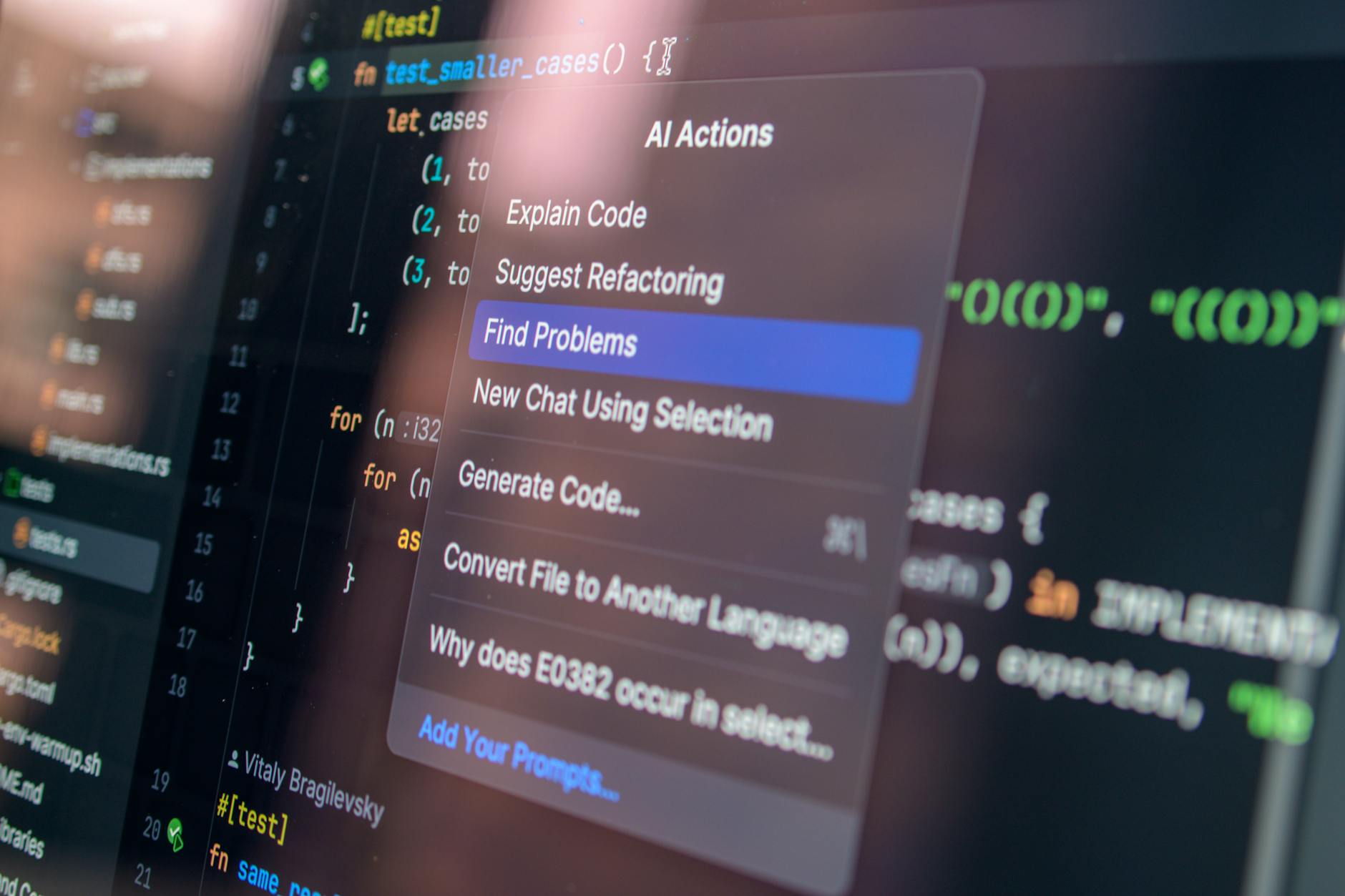

📷 Daniil Komov / PexelsDie besten KI-Code-Review-Tools in 2026: Automatisierte PR-Reviews im Vergleich

Vergleichen Sie die fuehrenden KI-Code-Review-Tools in 2026 einschliesslich GitHub Copilot, CodeRabbit, Sourcery, Qodo und mehr. Finden Sie das beste Tool fuer automatisierte PR-Reviews.

Code Review ist einer der zeitaufwaendigsten Teile des Softwareentwicklungszyklus. Im Jahr 2026 sind KI-gestuetzte Code-Review-Tools so weit ausgereift, dass sie Bugs erkennen, Verbesserungen vorschlagen, Best Practices durchsetzen und die Zeit, die menschliche Reviewer fuer jeden Pull Request aufwenden, drastisch reduzieren koennen. Dieser Leitfaden vergleicht die fuehrenden KI-Code-Review-Tools, die heute verfuegbar sind, und hilft Ihnen bei der Entscheidung, welches zu Ihrem Team passt.

Warum KI-Code-Review wichtig ist

Bevor wir uns den einzelnen Tools widmen, lohnt es sich zu verstehen, warum Teams KI-Code-Review so schnell uebernehmen.

Das Problem mit traditionellem Code Review

Manuelles Code Review ist essenziell fuer die Codequalitaet, bringt aber bekannte Herausforderungen mit sich:

- Engpass bei Senior Engineers: Die erfahrensten Entwickler verbringen einen ueberproportionalen Anteil ihrer Zeit mit der Ueberpruefung des Codes anderer, anstatt eigenen zu schreiben.

- Inkonsistentes Feedback: Verschiedene Reviewer konzentrieren sich auf unterschiedliche Dinge. Stilprobleme koennten von einem Reviewer erkannt, von einem anderen aber uebersehen werden.

- Langsame Bearbeitungszeit: PRs warten oft stunden- oder tagelang auf ein Review, was Deployments blockiert und die Iteration verlangsamt.

- Reviewer-Muedigkeit: Grosse PRs (500+ Zeilen) erhalten weniger gruendliche Reviews, weil Ermuedung einsetzt.

Was KI-Code-Review bietet

KI-Tools ersetzen keine menschlichen Reviewer. Sie ergaenzen sie, indem sie die sich wiederholenden, mechanischen Aspekte des Reviews uebernehmen:

- Sofortiges Feedback: KI-Reviews werden innerhalb von Minuten nach Eroeffnung eines PR gepostet und geben Entwicklern sofortige Orientierung.

- Konsistente Standards: Jeder PR wird jedes Mal nach denselben Kriterien bewertet.

- Bug-Erkennung: KI kann potenzielle Bugs, Sicherheitsluecken und Leistungsprobleme identifizieren, die Menschen moeglicherweise uebersehen.

- Kontextbewusstsein: Moderne KI-Tools verstehen den Projektkontext, Coding-Konventionen und sogar Geschaeftslogik, um relevante Vorschlaege zu liefern.

- Reduzierte Reviewer-Belastung: Menschliche Reviewer koennen sich auf Architektur, Designentscheidungen und Geschaeftslogik konzentrieren, anstatt auf Stil und offensichtliche Bugs.

Tool-Reviews

GitHub Copilot Code Review

GitHub Copilot hat sich weit ueber die Code-Vervollstaendigung hinaus entwickelt. Seine Code-Review-Funktion ist jetzt direkt in den GitHub-Pull-Request-Workflow integriert.

Funktionsweise: Wenn Sie einen PR eroeffnen, koennen Sie ein Review von Copilot anfordern, genau wie von einem menschlichen Reviewer. Copilot analysiert den Diff, versteht den Projektkontext aus umgebenden Dateien und postet Review-Kommentare mit konkreten Vorschlaegen.

Wichtige Features:

- Direkt in GitHub PRs integriert, ohne separates Tool zu installieren.

- Bietet Inline-Vorschlaege, die mit einem Klick akzeptiert werden koennen.

- Versteht den breiteren Codebasis-Kontext, nicht nur den Diff.

- Unterstuetzt benutzerdefinierte Review-Anweisungen ueber eine

.github/copilot-review-instructions.md-Datei. - Verfuegbar fuer GitHub Enterprise mit Richtlinienkontrollen.

Einrichtung:

- Stellen Sie sicher, dass Ihr Repository GitHub Copilot aktiviert hat.

- Eroeffnen Sie einen Pull Request.

- Fuegen Sie im Reviewer-Bereich "Copilot" als Reviewer hinzu.

- Copilot postet sein Review innerhalb von Minuten.

Um das Review-Verhalten anzupassen, erstellen Sie eine Datei unter .github/copilot-review-instructions.md:

# Copilot Review Instructions

## Focus Areas

- Always check for proper error handling in async functions

- Flag any direct database queries outside the repository layer

- Ensure all API endpoints validate input with Zod schemas

## Ignore

- CSS/styling changes (handled by design review)

- Dependency updates (handled by Dependabot)

Preise: Enthalten in GitHub Copilot Business (19 $/Benutzer/Monat) und Enterprise (39 $/Benutzer/Monat).

Am besten fuer: Teams, die bereits GitHub Copilot verwenden und eine nahtlose Integration ohne zusaetzliches Tool in ihrem Stack wuenschen.

CodeRabbit

CodeRabbit ist eine dedizierte KI-Code-Review-Plattform, die starke Verbreitung in der Open-Source-Community und bei mittelgrossen Engineering-Teams gefunden hat.

Funktionsweise: CodeRabbit verbindet sich mit Ihrem GitHub- oder GitLab-Repository und reviewt automatisch jeden PR. Es liefert eine Zusammenfassung mit Walkthrough, Inline-Kommentare und konversationsaehnliche Interaktionen, bei denen Sie Folgefragen stellen koennen.

Wichtige Features:

- Automatisches Review bei jedem PR ohne manuellen Trigger.

- Interaktive Konversationen: Antworten Sie auf CodeRabbit-Kommentare und es antwortet mit Klaerungen oder aktualisierten Vorschlaegen.

- Sequenzdiagramme und Aenderungs-Walkthroughs fuer komplexe PRs.

- Lernt im Laufe der Zeit aus Ihrer Codebasis und verbessert die Relevanz des Feedbacks.

- Unterstuetzt

.coderabbit.yaml-Konfiguration fuer benutzerdefinierte Regeln. - Integriert sich mit Jira und Linear, um den Kontext von Aenderungen zu verstehen.

Konfigurationsbeispiel:

# .coderabbit.yaml

language: en

reviews:

auto_review:

enabled: true

drafts: false

path_instructions:

- path: "src/api/**"

instructions: "Ensure all endpoints have proper authentication middleware and input validation."

- path: "src/db/**"

instructions: "Check for SQL injection risks and ensure migrations are reversible."

- path: "**/*.test.*"

instructions: "Verify edge cases are covered and mocks are properly cleaned up."

tools:

eslint:

enabled: true

biome:

enabled: true

Preise: Kostenlos fuer Open-Source-Projekte. Pro-Plan ab 15 $/Benutzer/Monat.

Am besten fuer: Teams, die ein dediziertes, funktionsreiches KI-Review-Tool mit interaktiven Faehigkeiten und tiefem Repository-Lernen wuenschen.

Sourcery

Sourcery begann als Python-Refactoring-Tool und hat sich zu einer umfassenden KI-Code-Review-Plattform entwickelt, die mehrere Sprachen unterstuetzt.

Funktionsweise: Sourcery reviewt PRs automatisch und konzentriert sich besonders auf Codequali-taets-Verbesserungen: Vereinfachung komplexer Logik, Entfernung von Duplikationen und Vorschlag idiomatischerer Muster.

Wichtige Features:

- Starker Fokus auf Refactoring-Vorschlaege, nicht nur Bug-Erkennung.

- Qualitaetsmetriken fuer jeden PR: Komplexitaetswerte, Duplikaterkennung und Lesbarkeitsbewertungen.

- Benutzerdefinierte Regeln, die die spezifischen Muster und Anti-Muster Ihres Teams abbilden koennen.

- IDE-Integration (VS Code, JetBrains) fuer Echtzeit-Vorschlaege beim Coding.

- Unterstuetzt Python, JavaScript, TypeScript und mehrere andere Sprachen.

Beispiel fuer benutzerdefinierte Regeln:

# .sourcery.yaml

rules:

- id: no-print-statements

description: Use logging instead of print statements

pattern: print(...)

replacement: logger.info(...)

languages: [python]

- id: prefer-const

description: Use const for variables that are never reassigned

pattern: let ${name} = ${value};

condition: not_reassigned(name)

replacement: const ${name} = ${value};

languages: [javascript, typescript]

Preise: Kostenlos fuer Open Source. Team-Plan ab 30 $/Benutzer/Monat.

Am besten fuer: Teams, die Codequalitaets-Metriken und Refactoring priorisieren. Besonders stark fuer Python-Projekte.

Qodo (ehemals CodiumAI)

Qodo verfolgt einen einzigartigen Ansatz, indem es sich stark auf Testgenerierung neben dem Code Review konzentriert. Es analysiert Ihre Codeaenderungen und schlaegt Testfaelle vor, die die geaenderte Logik abdecken.

Wichtige Features:

- Automatische Testgenerierung fuer Codeaenderungen in PRs.

- Verhaltensanalyse, die Grenzfaelle und Randbedingungen identifiziert.

- PR-Review mit Fokus auf Testbarkeit und Korrektheit.

- Unterstuetzt die Generierung von Tests fuer Python, JavaScript, TypeScript, Java und Go.

- Interaktive Testverfeinerung: Sagen Sie Qodo, welche Szenarien hinzugefuegt werden sollen, und es generiert sie.

Beispiel-Workflow:

Wenn Sie einen PR eroeffnen, der eine neue Funktion hinzufuegt, koennte Qodo vorschlagen:

// Von Qodo generierte Testvorschlaege fuer einen neuen Rabattrechner

describe('calculateDiscount', () => {

it('should return 0 discount for orders under $50', () => {

expect(calculateDiscount(49.99)).toBe(0);

});

it('should apply 10% discount for orders between $50 and $100', () => {

expect(calculateDiscount(75)).toBe(7.5);

});

it('should apply 20% discount for orders over $100', () => {

expect(calculateDiscount(150)).toBe(30);

});

it('should handle edge case of exactly $50', () => {

expect(calculateDiscount(50)).toBe(5);

});

it('should throw for negative amounts', () => {

expect(() => calculateDiscount(-10)).toThrow();

});

it('should handle zero amount', () => {

expect(calculateDiscount(0)).toBe(0);

});

});

Preise: Kostenlose Stufe mit begrenzter Nutzung. Teams-Plan ab 19 $/Benutzer/Monat.

Am besten fuer: Teams, die die Testabdeckung neben dem Code Review verbessern moechten. Besonders wertvoll fuer Projekte, bei denen Tests historisch vernachlaessigt wurden.

Ellipsis

Ellipsis konzentriert sich darauf, ein hochgradig konfigurierbarer, meinungsstarker Code-Review-Bot zu sein, der Team-Standards konsistent durchsetzt.

Wichtige Features:

- Regelbasiertes Review-System, das KI-Analyse mit deterministischen Pruefungen kombiniert.

- Automatische Kennzeichnung und Kategorisierung von PRs (Bugfix, Feature, Refactoring).

- Aenderungszusammenfassungen und Risikobewertung fuer jeden PR.

- Benutzerdefinierte Review-Profile fuer verschiedene Teile der Codebasis.

- Slack- und Teams-Benachrichtigungen mit Review-Zusammenfassungen.

Preise: Ab 20 $/Benutzer/Monat.

Am besten fuer: Teams, die eine strikte Durchsetzung von Coding-Standards benoetigen und eine detaillierte PR-Kategorisierung wuenschen.

Codeium (Windsurf)

Codeium, das Unternehmen hinter der Windsurf IDE, bietet KI-Code-Review als Teil seiner breiteren KI-Entwicklungsplattform an.

Wichtige Features:

- Code Review integriert mit der breiteren Windsurf-KI-Coding-Erfahrung.

- Kontextbewusste Reviews, die die gesamte Projektarchitektur verstehen.

- Sicherheitsluecken-Scanning eingebaut in den Review-Prozess.

- Unterstuetzung fuer 70+ Programmiersprachen.

- Self-Hosted-Option fuer Enterprise-Kunden verfuegbar.

Preise: Kostenlos fuer einzelne Entwickler. Enterprise-Preise variieren.

Am besten fuer: Teams, die bereits das Windsurf-Oekosystem nutzen und eine einheitliche KI-Entwicklungserfahrung wuenschen.

Vergleichstabelle

| Feature | GitHub Copilot | CodeRabbit | Sourcery | Qodo | Ellipsis | Codeium |

|---|---|---|---|---|---|---|

| Auto-Review bei PR | Manueller Trigger | Automatisch | Automatisch | Automatisch | Automatisch | Automatisch |

| Interaktiver Chat | Begrenzt | Ja | Nein | Ja | Nein | Ja |

| Testgenerierung | Nein | Nein | Nein | Ja | Nein | Nein |

| Benutzerdefinierte Regeln | Markdown-Datei | YAML-Konfiguration | YAML-Konfiguration | Begrenzt | Ja | Begrenzt |

| IDE-Integration | VS Code, JetBrains | Nein | VS Code, JetBrains | VS Code, JetBrains | Nein | Windsurf, VS Code |

| GitHub-Unterstuetzung | Nativ | Ja | Ja | Ja | Ja | Ja |

| GitLab-Unterstuetzung | Nein | Ja | Ja | Ja | Ja | Ja |

| Self-Hosted | Enterprise | Enterprise | Nein | Enterprise | Nein | Enterprise |

| Kostenlose Stufe | Nein | Open Source | Open Source | Begrenzt | Nein | Ja |

| Einstiegspreis | 19 $/Nutzer/Mo. | 15 $/Nutzer/Mo. | 30 $/Nutzer/Mo. | 19 $/Nutzer/Mo. | 20 $/Nutzer/Mo. | Kostenlos |

GitHub Copilot Code Review einrichten

Da GitHub Copilot die am weitesten verbreitete Option ist, folgt hier eine ausfuehrliche Einrichtungsanleitung.

Schritt 1: Copilot fuer Ihre Organisation aktivieren

Navigieren Sie in den Einstellungen Ihrer GitHub-Organisation zu "Copilot" und aktivieren Sie es fuer Ihre Repositories. Stellen Sie sicher, dass die Funktion "Code Review" eingeschaltet ist.

Schritt 2: Review-Anweisungen konfigurieren

Erstellen Sie eine Datei unter .github/copilot-review-instructions.md in Ihrem Repository:

# Review Guidelines

## Architecture

- Services should not directly access the database. Use repository classes.

- API routes must use middleware for authentication and rate limiting.

## Error Handling

- All async functions must have try/catch blocks or use an error boundary.

- Never swallow errors silently. Always log them.

## Security

- User input must be sanitized before use in database queries.

- API keys and secrets must never appear in code. Use environment variables.

## Testing

- New features must include unit tests.

- Bug fixes must include a regression test.

Schritt 3: Ein Review anfordern

Wenn Sie einen PR eroeffnen, fuegen Sie "Copilot" als Reviewer hinzu. Sie koennen dies auch als automatischen Reviewer ueber eine CODEOWNERS-Datei einrichten:

# .github/CODEOWNERS

# Copilot reviewt standardmaessig alle PRs

* @copilot

Schritt 4: Auf Feedback reagieren

Copilot postet Inline-Kommentare zu bestimmten Zeilen. Sie koennen Vorschlaege mit einem Klick akzeptieren, ablehnen oder antworten, um eine Konversation zu starten. Im Laufe der Zeit lernt Copilot aus Ihren Akzeptier-/Ablehnungsmustern.

CodeRabbit einrichten

Schritt 1: Die App installieren

Gehen Sie zur CodeRabbit GitHub App-Seite und installieren Sie sie in Ihrer Organisation. Waehlen Sie aus, auf welche Repositories sie Zugriff haben soll.

Schritt 2: Konfiguration hinzufuegen

Erstellen Sie .coderabbit.yaml im Stammverzeichnis Ihres Repositories:

language: en

early_access: true

reviews:

auto_review:

enabled: true

drafts: false

base_branches:

- main

- develop

request_changes_workflow: false

high_level_summary: true

poem: false

review_status: true

collapse_walkthrough: false

path_instructions:

- path: "**/*.ts"

instructions: "Check for proper TypeScript types. Avoid 'any' type."

- path: "src/api/**"

instructions: "Verify authentication, rate limiting, and input validation."

chat:

auto_reply: true

Schritt 3: Einen PR eroeffnen

CodeRabbit reviewt automatisch jeden PR. Es postet einen Zusammenfassungskommentar mit einem Walkthrough der Aenderungen und Inline-Review-Kommentare. Sie koennen mit ihm interagieren, indem Sie auf Kommentare mit Fragen antworten oder Aenderungen anfordern.

Best Practices fuer KI-gestuetztes Code Review

1. KI als ersten Durchgang verwenden, nicht als Ersatz

KI-Code-Review sollte der erste Schritt in Ihrem Review-Prozess sein, nicht der letzte. Lassen Sie die KI die offensichtlichen Probleme (Stil, potenzielle Bugs, fehlende Fehlerbehandlung) erkennen, damit menschliche Reviewer sich auf Design, Architektur und Geschaeftslogik konzentrieren koennen.

2. Regeln fuer Ihre Codebasis anpassen

Jede Codebasis hat spezifische Konventionen. Nehmen Sie sich die Zeit, benutzerdefinierte Regeln zu konfigurieren, die die Muster Ihres Teams widerspiegeln. Ein KI-Reviewer, der Ihre tatsaechlichen Standards durchsetzt, ist weitaus wertvoller als einer, der generische Ratschlaege gibt.

3. Den Reviewer ueberpruefen

Besonders in den ersten Wochen sollten Sie auf die Qualitaet der KI-Vorschlaege achten. Lehnen Sie irrelevante ab, damit das Tool lernt. Markieren Sie falsch-positive Ergebnisse. Diese Feedbackschleife verbessert die Genauigkeit des Tools im Laufe der Zeit.

4. PRs klein halten

KI-Code-Review-Tools funktionieren am besten bei fokussierten, kleinen PRs (unter 400 Zeilen Aenderungen). Grosse PRs ueberfordern sowohl KI- als auch menschliche Reviewer. Wenn Ihr Team mit grossen PRs kaempft, kann KI-Review-Feedback tatsaechlich helfen, kleinere, haeufigere Beitraege zu motivieren.

5. Mit Linting und CI kombinieren

KI-Code-Review ergaenzt, ersetzt aber nicht deterministische Tools. Verwenden Sie weiterhin ESLint, Prettier, Typueberpruefung und Test-Suites in CI. Lassen Sie die KI die nuancierten Vorschlaege behandeln, die statische Analyse nicht liefern kann.

6. Klare Erwartungen setzen

Stellen Sie sicher, dass Ihr Team versteht, dass KI-Review-Kommentare Vorschlaege sind, keine Anweisungen. Entwickler sollten ihr Urteilsvermoegen nutzen, welche Vorschlaege sie akzeptieren. Erstellen Sie eine Teamvereinbarung darueber, wie KI-Feedback behandelt werden soll.

Beispiel fuer Workflow-Integration

So koennte ein ausgereiftes Team KI-Code-Review in seinen Workflow integrieren:

Entwickler eroeffnet PR

|

v

CI laeuft (Lint, Typen, Tests)

|

v

KI-Review (CodeRabbit/Copilot) postet Kommentare innerhalb von 2-5 Minuten

|

v

Entwickler behandelt KI-Feedback und pusht Fixes

|

v

Menschlicher Reviewer zugewiesen (CODEOWNERS)

|

v

Mensch reviewt Architektur, Logik und verbleibende KI-Kommentare

|

v

PR genehmigt und gemergt

Dieser Workflow bedeutet, dass der menschliche Reviewer einen PR erhaelt, der bereits basierend auf KI-Feedback bereinigt wurde, was sein Review schneller und fokussierter auf uebergeordnete Anliegen macht.

Die Auswirkungen messen

Um die Investition in KI-Code-Review-Tools zu rechtfertigen, verfolgen Sie diese Metriken:

| Metrik | Was gemessen wird | Warum es wichtig ist |

|---|---|---|

| Zeit bis zum ersten Review | Wie schnell der erste Review-Kommentar erscheint | Schnelleres Feedback entblockiert Entwickler |

| Review-Zykluszeit | Zeit von PR-Eroeffnung bis Merge | Misst die gesamte Review-Effizienz |

| Im Review erkannte Bugs | Vor dem Merge gefundene Probleme | Direkter Qualitaetseinfluss |

| Eingesparte Reviewer-Stunden | Zeit, die Senior-Entwickler mit Reviews verbringen | Freigesetzte Kapazitaet fuer andere Arbeit |

| KI-Vorschlags-Akzeptanzrate | Welcher Prozentsatz der KI-Kommentare zu Aenderungen fuehrt | Zeigt Relevanz und Genauigkeit an |

Die meisten Teams berichten von einer 30-50%igen Reduktion der Review-Zykluszeit nach der Einfuehrung von KI-Code-Review, mit den groessten Gewinnen im ersten Review-Durchgang.

Fazit

KI-Code-Review-Tools haben 2026 einen Reifegrad erreicht, bei dem sie Entwicklungsteams echten, messbaren Mehrwert bieten. GitHub Copilot ist die einfachste Wahl fuer Teams, die bereits im GitHub-Oekosystem arbeiten. CodeRabbit bietet die funktionsreichste dedizierte Erfahrung mit starken interaktiven Faehigkeiten. Sourcery glaenzt bei Refactoring-Vorschlaegen und Codequalitaets-Metriken. Qodo fuellt eine einzigartige Nische mit seinen Testgenerierungs-Faehigkeiten.

Der beste Ansatz fuer die meisten Teams ist, mit einem Tool zu beginnen, es fuer die spezifische Codebasis zu konfigurieren und basierend auf der Qualitaet des Feedbacks zu iterieren. KI-Code-Review geht nicht darum, menschliches Urteilsvermoegen aus dem Prozess zu entfernen. Es geht darum, menschlichen Reviewern einen besseren Ausgangspunkt zu geben, damit sie sich auf die Entscheidungen konzentrieren koennen, die wirklich menschliche Einsicht erfordern.

Waehlen Sie ein Tool aus, richten Sie es diese Woche ein und messen Sie die Auswirkungen im naechsten Monat. Die Produktivitaetsgewinne sind real und unmittelbar.