2026年のベストAIコードレビューツール:自動PRレビューの比較

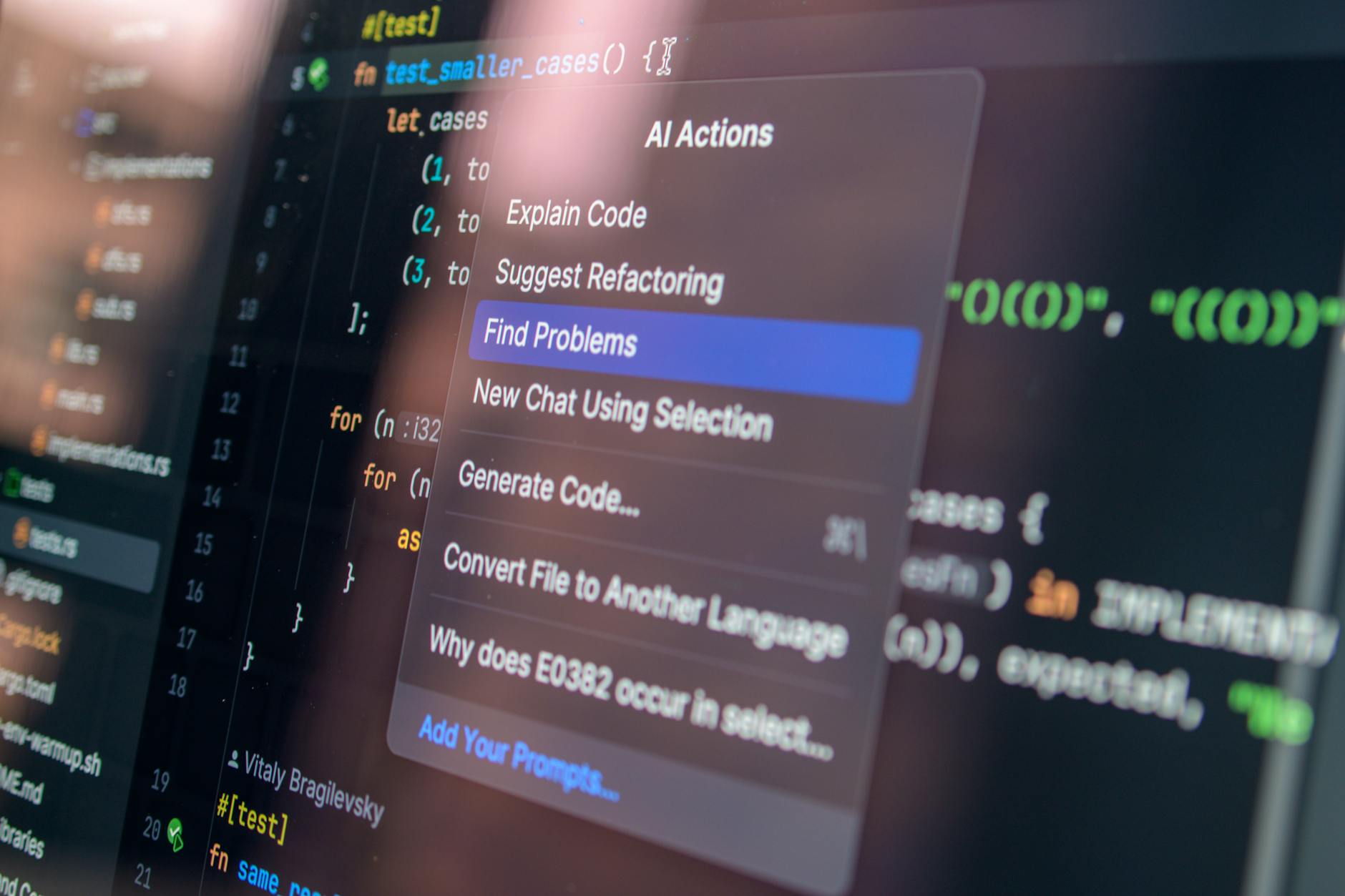

📷 Daniil Komov / Pexels2026年のベストAIコードレビューツール:自動PRレビューの比較

GitHub Copilot、CodeRabbit、Sourcery、Qodoなどを含む2026年のトップAIコードレビューツールを比較します。自動PRレビューに最適なツールを見つけましょう。

コードレビューはソフトウェア開発ライフサイクルの中で最も時間のかかる部分の一つです。2026年、AI搭載のコードレビューツールはバグの検出、改善提案、ベストプラクティスの適用、そしてヒューマンレビュアーが各プルリクエストに費やす時間の大幅な削減が可能なレベルまで成熟しています。このガイドでは、現在利用可能な主要なAIコードレビューツールを比較し、チームに合ったツールの選定をサポートします。

AIコードレビューが重要な理由

具体的なツールに入る前に、チームがAIコードレビューを急速に導入している理由を理解することが重要です。

従来のコードレビューの問題点

手動コードレビューはコード品質に不可欠ですが、よく知られた課題があります:

- シニアエンジニアのボトルネック:最も経験豊富な開発者が、自分のコードを書く代わりに他のメンバーのコードレビューに不釣り合いな時間を費やします。

- 一貫性のないフィードバック:レビュアーによって注目するポイントが異なります。あるレビュアーがスタイルの問題を見つけても、別のレビュアーは見逃すかもしれません。

- 遅いターンアラウンド:PRがレビュー待ちで数時間から数日間放置され、デプロイをブロックしイテレーションを遅くします。

- レビュアーの疲労:大きなPR(500行以上)は疲労が蓄積し、より徹底的でないレビューを受けます。

AIコードレビューが追加する価値

AIツールはヒューマンレビュアーを置き換えるものではありません。レビューの反復的で機械的な側面を処理することで補完します:

- 即時フィードバック:PRを開いてから数分以内にAIレビューが投稿され、開発者に即座のガイダンスを提供します。

- 一貫した基準:すべてのPRが毎回同じ基準で評価されます。

- バグ検出:AIが人間が見落とす可能性のある潜在的なバグ、セキュリティの脆弱性、パフォーマンスの問題を特定できます。

- コンテキスト認識:最新のAIツールはプロジェクトのコンテキスト、コーディング規約、さらにはビジネスロジックまで理解して関連性のある提案を提供します。

- レビュアーの負担軽減:ヒューマンレビュアーがスタイルや明白なバグではなく、アーキテクチャ、設計判断、ビジネスロジックに集中できます。

ツールレビュー

GitHub Copilotコードレビュー

GitHub Copilotはコード補完を大きく超えて拡張されています。コードレビュー機能がGitHubプルリクエストワークフローに直接統合されています。

仕組み:PRを開くと、ヒューマンレビュアーと同様にCopilotにレビューをリクエストできます。CopilotはDiffを分析し、周辺ファイルからプロジェクトコンテキストを理解し、具体的な提案を含むレビューコメントを投稿します。

主な機能:

- 別途ツールのインストールなしでGitHub PRに直接統合。

- ワンクリックで承認できるインラインの提案を提供。

- Diffだけでなくより広いコードベースコンテキストを理解。

.github/copilot-review-instructions.mdファイルによるカスタムレビュー指示をサポート。- ポリシー制御付きのGitHub Enterpriseで利用可能。

セットアップ:

- リポジトリでGitHub Copilotが有効になっていることを確認します。

- プルリクエストを開きます。

- レビュアーセクションで「Copilot」をレビュアーとして追加します。

- Copilotが数分以内にレビューを投稿します。

レビューの動作をカスタマイズするには、.github/copilot-review-instructions.mdファイルを作成します:

# Copilot Review Instructions

## Focus Areas

- Always check for proper error handling in async functions

- Flag any direct database queries outside the repository layer

- Ensure all API endpoints validate input with Zod schemas

## Ignore

- CSS/styling changes (handled by design review)

- Dependency updates (handled by Dependabot)

料金:GitHub Copilot Business($19/ユーザー/月)およびEnterprise($39/ユーザー/月)に含まれます。

最適な対象:すでにGitHub Copilotを使用しており、スタックに別のツールを追加せずにシームレスな統合を求めるチーム。

CodeRabbit

CodeRabbitはオープンソースコミュニティと中規模エンジニアリングチームで強い支持を得ている専用AIコードレビュープラットフォームです。

仕組み:CodeRabbitはGitHubまたはGitLabリポジトリに接続し、すべてのPRを自動的にレビューします。ウォークスルーサマリー、インラインコメント、フォローアップの質問ができる会話スタイルのインタラクションを提供します。

主な機能:

- 手動トリガーなしですべてのPRに対する自動レビュー。

- インタラクティブな会話:CodeRabbitのコメントに返信すると、説明や更新された提案で応答。

- 複雑なPRのためのシーケンス図と変更ウォークスルー。

- コードベースから時間をかけて学習し、フィードバックの関連性を向上。

- カスタムルールのための

.coderabbit.yaml設定をサポート。 - JiraおよびLinearとの統合で変更のコンテキストを理解。

設定例:

# .coderabbit.yaml

language: en

reviews:

auto_review:

enabled: true

drafts: false

path_instructions:

- path: "src/api/**"

instructions: "Ensure all endpoints have proper authentication middleware and input validation."

- path: "src/db/**"

instructions: "Check for SQL injection risks and ensure migrations are reversible."

- path: "**/*.test.*"

instructions: "Verify edge cases are covered and mocks are properly cleaned up."

tools:

eslint:

enabled: true

biome:

enabled: true

料金:オープンソースプロジェクトは無料。Proプランは$15/ユーザー/月から。

最適な対象:インタラクティブ機能と深いリポジトリ学習を備えた、機能豊富な専用AIレビューツールを求めるチーム。

Sourcery

SourceryはPythonリファクタリングツールとしてスタートし、複数の言語をサポートする包括的なAIコードレビュープラットフォームに進化しました。

仕組み:SourceryはPRを自動的にレビューし、特にコード品質の改善に焦点を当てます:複雑なロジックの簡素化、重複の除去、より慣用的なパターンの提案。

主な機能:

- バグ検出だけでなくリファクタリング提案に強い焦点。

- すべてのPRに対する品質メトリクス:複雑度スコア、重複検出、可読性グレード。

- チーム固有のパターンとアンチパターンをエンコードできるカスタムルール。

- コーディング中のリアルタイム提案のためのIDE統合(VS Code、JetBrains)。

- Python、JavaScript、TypeScript、その他複数の言語をサポート。

カスタムルールの例:

# .sourcery.yaml

rules:

- id: no-print-statements

description: Use logging instead of print statements

pattern: print(...)

replacement: logger.info(...)

languages: [python]

- id: prefer-const

description: Use const for variables that are never reassigned

pattern: let ${name} = ${value};

condition: not_reassigned(name)

replacement: const ${name} = ${value};

languages: [javascript, typescript]

料金:オープンソース無料。チームプラン$30/ユーザー/月。

最適な対象:コード品質メトリクスとリファクタリングを優先するチーム。Pythonプロジェクトに特に強いです。

Qodo(旧CodiumAI)

Qodoはコードレビューと並行してテスト生成に大きく焦点を当てたユニークなアプローチを取ります。コード変更を分析し、修正されたロジックをカバーするテストケースを提案します。

主な機能:

- PRのコード変更に対する自動テスト生成。

- エッジケースと境界条件を特定する動作分析。

- テスタビリティと正確性に焦点を当てたPRレビュー。

- Python、JavaScript、TypeScript、Java、Goのテスト生成をサポート。

- インタラクティブなテスト改善:追加したいシナリオを伝えると生成。

ワークフローの例:

新しい関数を追加するPRを開くと、Qodoが次のように提案する場合があります:

// Qodo-generated test suggestions for a new discount calculator

describe('calculateDiscount', () => {

it('should return 0 discount for orders under $50', () => {

expect(calculateDiscount(49.99)).toBe(0);

});

it('should apply 10% discount for orders between $50 and $100', () => {

expect(calculateDiscount(75)).toBe(7.5);

});

it('should apply 20% discount for orders over $100', () => {

expect(calculateDiscount(150)).toBe(30);

});

it('should handle edge case of exactly $50', () => {

expect(calculateDiscount(50)).toBe(5);

});

it('should throw for negative amounts', () => {

expect(() => calculateDiscount(-10)).toThrow();

});

it('should handle zero amount', () => {

expect(calculateDiscount(0)).toBe(0);

});

});

料金:使用量制限付きの無料ティア。チームプラン$19/ユーザー/月。

最適な対象:コードレビューと並行してテストカバレッジを改善したいチーム。テストが歴史的に軽視されてきたプロジェクトに特に価値があります。

Ellipsis

Ellipsisはチームの標準を一貫して適用できる、高度に設定可能で意見のあるコードレビューボットに焦点を当てています。

主な機能:

- AI分析と決定論的チェックを組み合わせたルールベースのレビューシステム。

- PRの自動ラベリングと分類(バグ修正、機能、リファクタリング)。

- 各PRの変更サマリーとリスク評価。

- コードベースの異なる部分に対するカスタムレビュープロファイル。

- レビューサマリー付きのSlackおよびTeams通知。

料金:$20/ユーザー/月から。

最適な対象:コーディング標準の厳格な適用と詳細なPR分類が必要なチーム。

Codeium(Windsurf)

Windsurf IDEを作った会社Codeiumは、より広範なAI開発プラットフォームの一部としてAIコードレビューを提供しています。

主な機能:

- より広範なWindsurf AIコーディング体験と統合されたコードレビュー。

- プロジェクト全体のアーキテクチャを理解するコンテキスト認識レビュー。

- レビュープロセスに組み込まれたセキュリティ脆弱性スキャニング。

- 70以上のプログラミング言語をサポート。

- エンタープライズ顧客向けのセルフホストオプション。

料金:個人開発者は無料。エンタープライズ価格は別途。

最適な対象:すでにWindsurfエコシステムを使用しており、統一されたAI開発体験を求めるチーム。

比較表

| 機能 | GitHub Copilot | CodeRabbit | Sourcery | Qodo | Ellipsis | Codeium |

|---|---|---|---|---|---|---|

| PR自動レビュー | 手動トリガー | 自動 | 自動 | 自動 | 自動 | 自動 |

| インタラクティブチャット | 限定的 | はい | いいえ | はい | いいえ | はい |

| テスト生成 | いいえ | いいえ | いいえ | はい | いいえ | いいえ |

| カスタムルール | Markdownファイル | YAML設定 | YAML設定 | 限定的 | はい | 限定的 |

| IDE統合 | VS Code, JetBrains | いいえ | VS Code, JetBrains | VS Code, JetBrains | いいえ | Windsurf, VS Code |

| GitHubサポート | ネイティブ | はい | はい | はい | はい | はい |

| GitLabサポート | いいえ | はい | はい | はい | はい | はい |

| セルフホスト | Enterprise | Enterprise | いいえ | Enterprise | いいえ | Enterprise |

| 無料ティア | いいえ | オープンソース | オープンソース | 限定的 | いいえ | はい |

| 開始価格 | $19/ユーザー/月 | $15/ユーザー/月 | $30/ユーザー/月 | $19/ユーザー/月 | $20/ユーザー/月 | 無料 |

GitHub Copilotコードレビューのセットアップ

GitHub Copilotが最も広く使用されているオプションなので、詳細なセットアップガイドを提供します。

ステップ1:組織でCopilotを有効にする

GitHub組織の設定で「Copilot」に移動し、リポジトリで有効にします。「Code review」機能がオンになっていることを確認します。

ステップ2:レビュー指示を設定する

リポジトリに.github/copilot-review-instructions.mdファイルを作成します:

# Review Guidelines

## Architecture

- Services should not directly access the database. Use repository classes.

- API routes must use middleware for authentication and rate limiting.

## Error Handling

- All async functions must have try/catch blocks or use an error boundary.

- Never swallow errors silently. Always log them.

## Security

- User input must be sanitized before use in database queries.

- API keys and secrets must never appear in code. Use environment variables.

## Testing

- New features must include unit tests.

- Bug fixes must include a regression test.

ステップ3:レビューをリクエストする

PRを開く際に「Copilot」をレビュアーとして追加します。CODEOWNERSファイルを使用して自動レビュアーとして設定することもできます:

# .github/CODEOWNERS

# Copilot reviews all PRs by default

* @copilot

ステップ4:フィードバックに対応する

Copilotは特定の行にインラインコメントを投稿します。ワンクリックで提案を承認したり、却下したり、会話を始めるために返信できます。時間の経過とともに、Copilotは承認/却下パターンから学習します。

CodeRabbitのセットアップ

ステップ1:アプリをインストール

CodeRabbit GitHub Appページに移動し、組織にインストールします。アクセスを許可するリポジトリを選択します。

ステップ2:設定を追加

リポジトリルートに.coderabbit.yamlを作成します:

language: en

early_access: true

reviews:

auto_review:

enabled: true

drafts: false

base_branches:

- main

- develop

request_changes_workflow: false

high_level_summary: true

poem: false

review_status: true

collapse_walkthrough: false

path_instructions:

- path: "**/*.ts"

instructions: "Check for proper TypeScript types. Avoid 'any' type."

- path: "src/api/**"

instructions: "Verify authentication, rate limiting, and input validation."

chat:

auto_reply: true

ステップ3:PRを開く

CodeRabbitはすべてのPRを自動的にレビューします。変更のウォークスルーとインラインレビューコメントを含むサマリーコメントを投稿します。コメントに質問で返信したり、変更をリクエストしてインタラクションできます。

AI支援コードレビューのベストプラクティス

1. AIをファーストパスとして使い、置き換えとして使わない

AIコードレビューはレビュープロセスの最初のステップであるべきで、最後ではありません。AIに明白な問題(スタイル、潜在的なバグ、不足しているエラー処理)を検出させ、ヒューマンレビュアーが設計、アーキテクチャ、ビジネスロジックに集中できるようにしましょう。

2. コードベースに合わせてルールをカスタマイズする

すべてのコードベースには特定の規約があります。チームのパターンを反映するカスタムルールの設定に時間を投資しましょう。実際の標準を適用するAIレビュアーは、一般的なアドバイスを提供するものよりはるかに価値があります。

3. レビュアーをレビューする

特に最初の数週間は、AIの提案の品質に注意を払ってください。関連のない提案は却下してツールが学習できるようにしましょう。偽陽性にフラグを立ててください。このフィードバックループが時間の経過とともにツールの精度を向上させます。

4. PRを小さく保つ

AIコードレビューツールは、焦点を絞った小さなPR(400行未満の変更)で最も効果的に機能します。大きなPRはAIとヒューマンレビュアーの両方を圧倒します。チームが大きなPRで苦労している場合、AIレビューのフィードバックが実際により小さく頻繁な貢献を促進する動機になり得ます。

5. リンティングとCIと組み合わせる

AIコードレビューは決定論的ツールを補完しますが、置き換えるものではありません。CIでESLint、Prettier、型チェック、テストスイートを引き続き使用してください。AIには静的解析が提供できない微妙な提案を処理させましょう。

6. 明確な期待値を設定する

AIレビューコメントは命令ではなく提案であることをチームに理解させてください。開発者はどの提案を受け入れるかを判断する必要があります。AIフィードバックの取り扱いに関するチームの合意を作成しましょう。

ワークフロー統合の例

成熟したチームがAIコードレビューをワークフローに統合する方法は次の通りです:

開発者がPRを開く

|

v

CIが実行(リント、型、テスト)

|

v

AIレビュー(CodeRabbit/Copilot)が2〜5分以内にコメントを投稿

|

v

開発者がAIフィードバックに対応して修正をプッシュ

|

v

ヒューマンレビュアーを割り当て(CODEOWNERS)

|

v

ヒューマンがアーキテクチャ、ロジック、残りのAIコメントをレビュー

|

v

PR承認とマージ

このワークフローにより、ヒューマンレビュアーはAIフィードバックに基づいてすでにクリーンアップされたPRを受け取り、レビューがより速く高レベルの関心事に集中できるようになります。

影響の測定

AIコードレビューツールへの投資を正当化するために、以下のメトリクスを追跡してください:

| メトリクス | 測定対象 | 重要な理由 |

|---|---|---|

| 最初のレビューまでの時間 | 最初のレビューコメントが表示されるまでの速度 | 迅速なフィードバックが開発者のブロックを解除 |

| レビューサイクルタイム | PRオープンからマージまでの時間 | 全体的なレビュー効率を測定 |

| レビューで検出されたバグ | マージ前に発見された問題 | 直接的な品質への影響 |

| レビュアーの時間節約 | シニア開発者がレビューに費やす時間 | 他の作業のために確保された能力 |

| AI提案の承認率 | AIコメントのうち変更につながった割合 | 関連性と精度を示す |

ほとんどのチームがAIコードレビュー導入後、レビューサイクルタイムが30〜50%削減されたと報告しており、最大の効果は最初のレビューパスで現れています。

まとめ

2026年のAIコードレビューツールは、開発チームに真の測定可能な価値を提供するレベルの成熟度に達しています。GitHub Copilotはすでにgithubエコシステムにいるチームにとって最も簡単な選択です。CodeRabbitは強力なインタラクティブ機能を備えた最も機能豊富な専用エクスペリエンスを提供します。Sourceryはリファクタリング提案とコード品質メトリクスに優れています。Qodoはテスト生成機能でユニークなニッチを埋めています。

ほとんどのチームにとって最良のアプローチは、1つのツールから始めて特定のコードベースに合わせて設定し、フィードバックの品質に基づいてイテレーションすることです。AIコードレビューはプロセスから人間の判断を取り除くことではありません。真に人間の洞察を必要とする決定に集中できるよう、ヒューマンレビュアーにより良い出発点を提供することです。

ツールを選び、今週中にセットアップし、次の1か月間で影響を測定してみてください。生産性の向上は実際的で即座に感じられます。