2026년 최고의 AI 코드 리뷰 도구: 자동화된 PR 리뷰 비교

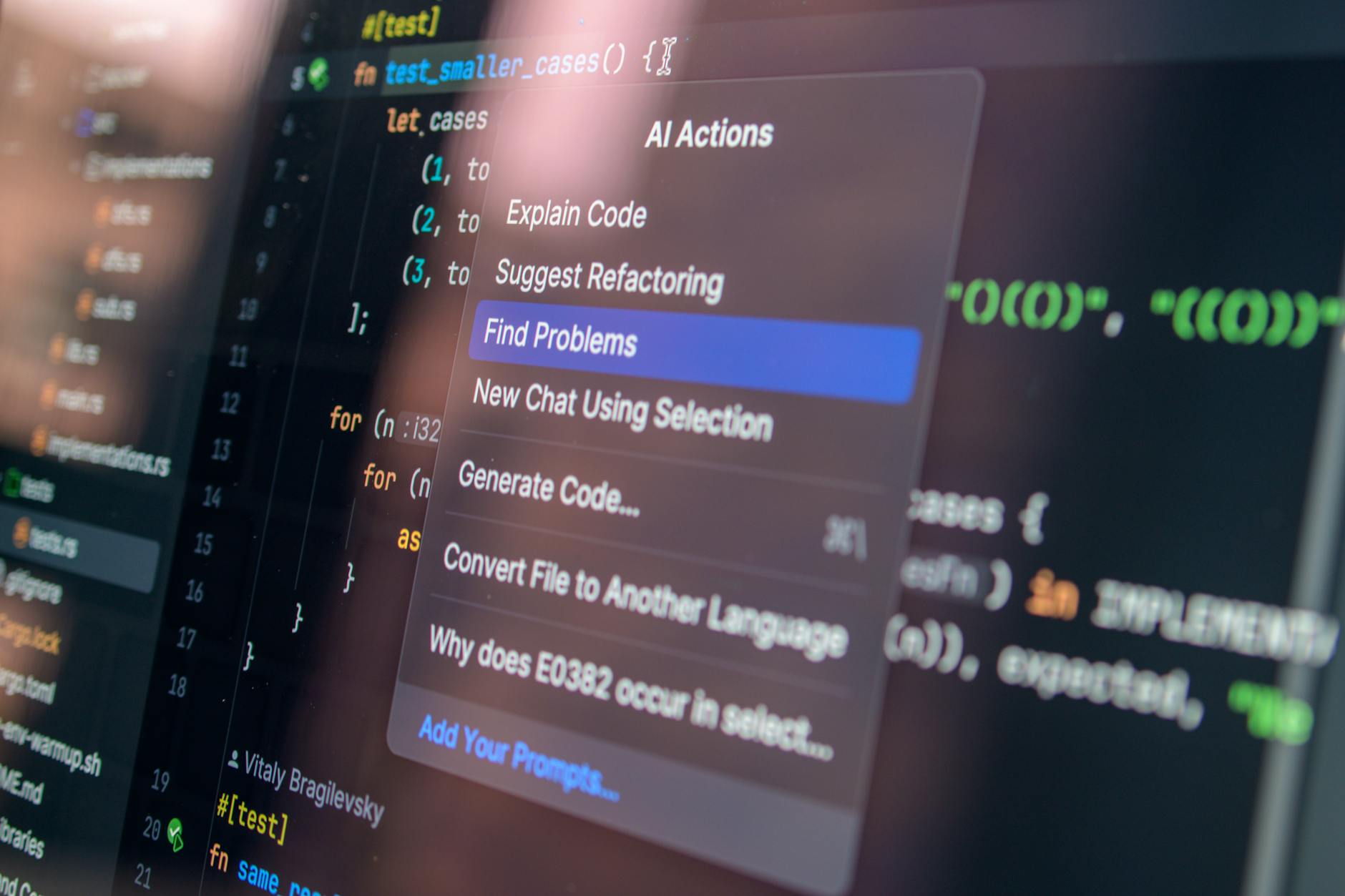

📷 Daniil Komov / Pexels2026년 최고의 AI 코드 리뷰 도구: 자동화된 PR 리뷰 비교

GitHub Copilot, CodeRabbit, Sourcery, Qodo 등을 포함한 2026년 최고의 AI 코드 리뷰 도구를 비교합니다. 자동화된 PR 리뷰에 최적의 도구를 찾아보세요.

코드 리뷰는 소프트웨어 개발 라이프사이클에서 가장 시간이 많이 소요되는 부분 중 하나입니다. 2026년에 AI 기반 코드 리뷰 도구는 버그를 잡고, 개선사항을 제안하고, 모범 사례를 적용하며, 인간 리뷰어가 각 풀 리퀘스트에 소비하는 시간을 크게 줄일 수 있을 정도로 성숙했습니다. 이 가이드에서는 현재 이용 가능한 주요 AI 코드 리뷰 도구를 비교하여 팀에 맞는 도구를 결정하는 데 도움을 드립니다.

AI 코드 리뷰가 중요한 이유

구체적인 도구를 살펴보기 전에 팀들이 AI 코드 리뷰를 빠르게 도입하는 이유를 이해하는 것이 중요합니다.

전통적인 코드 리뷰의 문제점

수동 코드 리뷰는 코드 품질에 필수적이지만, 잘 알려진 과제가 있습니다:

- 시니어 엔지니어의 병목: 가장 경험이 많은 개발자가 자신의 코드를 작성하는 대신 다른 사람의 코드를 리뷰하는 데 불균형하게 많은 시간을 소비합니다.

- 일관성 없는 피드백: 리뷰어마다 다른 것에 집중합니다. 한 리뷰어가 잡는 스타일 이슈를 다른 리뷰어는 놓칠 수 있습니다.

- 느린 응답 시간: PR이 리뷰를 기다리며 몇 시간 또는 며칠 동안 대기하여 배포를 차단하고 반복을 늦춥니다.

- 리뷰어 피로: 큰 PR(500줄 이상)은 피로가 누적되어 덜 철저한 리뷰를 받습니다.

AI 코드 리뷰가 추가하는 가치

AI 도구는 인간 리뷰어를 대체하지 않습니다. 리뷰의 반복적이고 기계적인 측면을 처리하여 보완합니다:

- 즉각적인 피드백: PR을 열면 몇 분 내에 AI 리뷰가 게시되어 개발자에게 즉각적인 가이드를 제공합니다.

- 일관된 기준: 모든 PR이 매번 동일한 기준으로 평가됩니다.

- 버그 감지: AI가 인간이 놓칠 수 있는 잠재적 버그, 보안 취약점, 성능 이슈를 식별할 수 있습니다.

- 컨텍스트 인식: 최신 AI 도구는 프로젝트 컨텍스트, 코딩 컨벤션, 심지어 비즈니스 로직까지 이해하여 관련성 있는 제안을 제공합니다.

- 리뷰어 부담 감소: 인간 리뷰어가 스타일과 명백한 버그 대신 아키텍처, 설계 결정, 비즈니스 로직에 집중할 수 있습니다.

도구 리뷰

GitHub Copilot 코드 리뷰

GitHub Copilot은 코드 완성을 훨씬 넘어 확장되었습니다. 코드 리뷰 기능이 이제 GitHub 풀 리퀘스트 워크플로에 직접 통합되어 있습니다.

작동 방식: PR을 열면 인간 리뷰어에게 하듯이 Copilot에게 리뷰를 요청할 수 있습니다. Copilot은 diff를 분석하고, 주변 파일에서 프로젝트 컨텍스트를 이해하며, 구체적인 제안과 함께 리뷰 코멘트를 게시합니다.

주요 기능:

- 별도 도구 설치 없이 GitHub PR에 직접 통합.

- 한 번의 클릭으로 수락할 수 있는 인라인 제안 제공.

- diff뿐만 아니라 더 넓은 코드베이스 컨텍스트를 이해.

.github/copilot-review-instructions.md파일을 통한 커스텀 리뷰 지침 지원.- 정책 제어가 가능한 GitHub Enterprise에서 사용 가능.

설정:

- 리포지토리에서 GitHub Copilot이 활성화되어 있는지 확인합니다.

- 풀 리퀘스트를 엽니다.

- 리뷰어 섹션에서 "Copilot"을 리뷰어로 추가합니다.

- Copilot이 몇 분 내에 리뷰를 게시합니다.

리뷰 동작을 커스터마이징하려면 .github/copilot-review-instructions.md 파일을 생성하세요:

# Copilot Review Instructions

## Focus Areas

- Always check for proper error handling in async functions

- Flag any direct database queries outside the repository layer

- Ensure all API endpoints validate input with Zod schemas

## Ignore

- CSS/styling changes (handled by design review)

- Dependency updates (handled by Dependabot)

가격: GitHub Copilot Business($19/사용자/월) 및 Enterprise($39/사용자/월)에 포함.

최적 대상: 이미 GitHub Copilot을 사용하고 있으며 스택에 다른 도구를 추가하지 않고 원활한 통합을 원하는 팀.

CodeRabbit

CodeRabbit은 오픈소스 커뮤니티와 중간 규모 엔지니어링 팀에서 강한 견인력을 얻은 전용 AI 코드 리뷰 플랫폼입니다.

작동 방식: CodeRabbit은 GitHub 또는 GitLab 리포지토리에 연결되어 모든 PR을 자동으로 리뷰합니다. 안내 요약, 인라인 코멘트, 후속 질문을 할 수 있는 대화 스타일 상호작용을 제공합니다.

주요 기능:

- 수동 트리거 없이 모든 PR에 대한 자동 리뷰.

- 대화형 상호작용: CodeRabbit 코멘트에 답변하면 설명이나 업데이트된 제안으로 응답.

- 복잡한 PR을 위한 시퀀스 다이어그램과 변경 안내.

- 시간이 지남에 따라 코드베이스에서 학습하여 피드백의 관련성 향상.

- 커스텀 규칙을 위한

.coderabbit.yaml설정 지원. - Jira 및 Linear와 통합하여 변경 컨텍스트 이해.

설정 예제:

# .coderabbit.yaml

language: en

reviews:

auto_review:

enabled: true

drafts: false

path_instructions:

- path: "src/api/**"

instructions: "Ensure all endpoints have proper authentication middleware and input validation."

- path: "src/db/**"

instructions: "Check for SQL injection risks and ensure migrations are reversible."

- path: "**/*.test.*"

instructions: "Verify edge cases are covered and mocks are properly cleaned up."

tools:

eslint:

enabled: true

biome:

enabled: true

가격: 오픈소스 프로젝트는 무료. Pro 플랜은 $15/사용자/월부터.

최적 대상: 대화형 기능과 깊은 리포지토리 학습이 가능한 전용 기능이 풍부한 AI 리뷰 도구를 원하는 팀.

Sourcery

Sourcery는 Python 리팩토링 도구로 시작하여 여러 언어를 지원하는 포괄적인 AI 코드 리뷰 플랫폼으로 발전했습니다.

작동 방식: Sourcery는 PR을 자동으로 리뷰하며 특히 코드 품질 개선에 집중합니다: 복잡한 로직 간소화, 중복 제거, 더 관용적인 패턴 제안.

주요 기능:

- 버그 감지뿐만 아니라 리팩토링 제안에 강한 초점.

- 모든 PR에 대한 품질 메트릭: 복잡도 점수, 중복 감지, 가독성 등급.

- 팀의 특정 패턴과 안티패턴을 인코딩할 수 있는 커스텀 규칙.

- 코딩 중 실시간 제안을 위한 IDE 통합 (VS Code, JetBrains).

- Python, JavaScript, TypeScript 및 여러 다른 언어 지원.

커스텀 규칙 예제:

# .sourcery.yaml

rules:

- id: no-print-statements

description: Use logging instead of print statements

pattern: print(...)

replacement: logger.info(...)

languages: [python]

- id: prefer-const

description: Use const for variables that are never reassigned

pattern: let ${name} = ${value};

condition: not_reassigned(name)

replacement: const ${name} = ${value};

languages: [javascript, typescript]

가격: 오픈소스 무료. 팀 플랜 $30/사용자/월.

최적 대상: 코드 품질 메트릭과 리팩토링을 우선시하는 팀. Python 프로젝트에 특히 강합니다.

Qodo (이전 CodiumAI)

Qodo는 코드 리뷰와 함께 테스트 생성에 크게 집중하는 독특한 접근 방식을 취합니다. 코드 변경을 분석하고 수정된 로직을 커버하는 테스트 케이스를 제안합니다.

주요 기능:

- PR의 코드 변경에 대한 자동 테스트 생성.

- 엣지 케이스와 경계 조건을 식별하는 동작 분석.

- 테스트 가능성과 정확성에 초점을 맞춘 PR 리뷰.

- Python, JavaScript, TypeScript, Java, Go 테스트 생성 지원.

- 대화형 테스트 개선: 추가할 시나리오를 알려주면 생성.

예제 워크플로:

새 함수를 추가하는 PR을 열면, Qodo가 다음과 같이 제안할 수 있습니다:

// Qodo-generated test suggestions for a new discount calculator

describe('calculateDiscount', () => {

it('should return 0 discount for orders under $50', () => {

expect(calculateDiscount(49.99)).toBe(0);

});

it('should apply 10% discount for orders between $50 and $100', () => {

expect(calculateDiscount(75)).toBe(7.5);

});

it('should apply 20% discount for orders over $100', () => {

expect(calculateDiscount(150)).toBe(30);

});

it('should handle edge case of exactly $50', () => {

expect(calculateDiscount(50)).toBe(5);

});

it('should throw for negative amounts', () => {

expect(() => calculateDiscount(-10)).toThrow();

});

it('should handle zero amount', () => {

expect(calculateDiscount(0)).toBe(0);

});

});

가격: 제한된 사용량의 무료 티어. 팀 플랜 $19/사용자/월.

최적 대상: 코드 리뷰와 함께 테스트 커버리지를 개선하고 싶은 팀. 테스팅이 역사적으로 소홀했던 프로젝트에 특히 가치 있습니다.

Ellipsis

Ellipsis는 팀 표준을 일관되게 적용할 수 있는 고도로 설정 가능하고 의견이 있는 코드 리뷰 봇에 초점을 맞춥니다.

주요 기능:

- AI 분석과 결정론적 검사를 결합한 규칙 기반 리뷰 시스템.

- PR의 자동 레이블링 및 분류 (버그 수정, 기능, 리팩토링).

- 각 PR에 대한 변경 요약 및 위험 평가.

- 코드베이스의 다른 부분에 대한 커스텀 리뷰 프로필.

- 리뷰 요약이 포함된 Slack 및 Teams 알림.

가격: $20/사용자/월부터.

최적 대상: 코딩 표준의 엄격한 적용과 상세한 PR 분류가 필요한 팀.

Codeium (Windsurf)

Windsurf IDE를 만든 회사 Codeium은 더 넓은 AI 개발 플랫폼의 일부로 AI 코드 리뷰를 제공합니다.

주요 기능:

- 더 넓은 Windsurf AI 코딩 경험과 통합된 코드 리뷰.

- 전체 프로젝트 아키텍처를 이해하는 컨텍스트 인식 리뷰.

- 리뷰 프로세스에 내장된 보안 취약점 스캐닝.

- 70개 이상의 프로그래밍 언어 지원.

- 엔터프라이즈 고객을 위한 셀프 호스팅 옵션.

가격: 개인 개발자 무료. 엔터프라이즈 가격은 별도.

최적 대상: 이미 Windsurf 에코시스템을 사용하고 있으며 통합된 AI 개발 경험을 원하는 팀.

비교표

| 기능 | GitHub Copilot | CodeRabbit | Sourcery | Qodo | Ellipsis | Codeium |

|---|---|---|---|---|---|---|

| PR 자동 리뷰 | 수동 트리거 | 자동 | 자동 | 자동 | 자동 | 자동 |

| 대화형 채팅 | 제한적 | 예 | 아니오 | 예 | 아니오 | 예 |

| 테스트 생성 | 아니오 | 아니오 | 아니오 | 예 | 아니오 | 아니오 |

| 커스텀 규칙 | Markdown 파일 | YAML 설정 | YAML 설정 | 제한적 | 예 | 제한적 |

| IDE 통합 | VS Code, JetBrains | 아니오 | VS Code, JetBrains | VS Code, JetBrains | 아니오 | Windsurf, VS Code |

| GitHub 지원 | 네이티브 | 예 | 예 | 예 | 예 | 예 |

| GitLab 지원 | 아니오 | 예 | 예 | 예 | 예 | 예 |

| 셀프 호스팅 | Enterprise | Enterprise | 아니오 | Enterprise | 아니오 | Enterprise |

| 무료 티어 | 아니오 | 오픈소스 | 오픈소스 | 제한적 | 아니오 | 예 |

| 시작 가격 | $19/사용자/월 | $15/사용자/월 | $30/사용자/월 | $19/사용자/월 | $20/사용자/월 | 무료 |

GitHub Copilot 코드 리뷰 설정하기

GitHub Copilot이 가장 널리 사용되는 옵션이므로, 여기에 상세한 설정 가이드를 제공합니다.

1단계: 조직에서 Copilot 활성화

GitHub 조직 설정에서 "Copilot"으로 이동하여 리포지토리에서 활성화합니다. "Code review" 기능이 켜져 있는지 확인합니다.

2단계: 리뷰 지침 설정

리포지토리에 .github/copilot-review-instructions.md 파일을 생성합니다:

# Review Guidelines

## Architecture

- Services should not directly access the database. Use repository classes.

- API routes must use middleware for authentication and rate limiting.

## Error Handling

- All async functions must have try/catch blocks or use an error boundary.

- Never swallow errors silently. Always log them.

## Security

- User input must be sanitized before use in database queries.

- API keys and secrets must never appear in code. Use environment variables.

## Testing

- New features must include unit tests.

- Bug fixes must include a regression test.

3단계: 리뷰 요청

PR을 열 때 "Copilot"을 리뷰어로 추가합니다. CODEOWNERS 파일을 사용하여 자동 리뷰어로 설정할 수도 있습니다:

# .github/CODEOWNERS

# Copilot reviews all PRs by default

* @copilot

4단계: 피드백에 응답

Copilot은 특정 라인에 인라인 코멘트를 게시합니다. 한 번의 클릭으로 제안을 수락하거나, 무시하거나, 대화를 시작하기 위해 답변할 수 있습니다. 시간이 지남에 따라 Copilot은 수락/무시 패턴에서 학습합니다.

CodeRabbit 설정하기

1단계: 앱 설치

CodeRabbit GitHub App 페이지로 이동하여 조직에 설치합니다. 접근 권한을 부여할 리포지토리를 선택합니다.

2단계: 설정 추가

리포지토리 루트에 .coderabbit.yaml을 생성합니다:

language: en

early_access: true

reviews:

auto_review:

enabled: true

drafts: false

base_branches:

- main

- develop

request_changes_workflow: false

high_level_summary: true

poem: false

review_status: true

collapse_walkthrough: false

path_instructions:

- path: "**/*.ts"

instructions: "Check for proper TypeScript types. Avoid 'any' type."

- path: "src/api/**"

instructions: "Verify authentication, rate limiting, and input validation."

chat:

auto_reply: true

3단계: PR 열기

CodeRabbit은 모든 PR을 자동으로 리뷰합니다. 변경 안내와 인라인 리뷰 코멘트가 포함된 요약 코멘트를 게시합니다. 코멘트에 질문으로 답변하거나 변경을 요청하여 상호작용할 수 있습니다.

AI 지원 코드 리뷰 모범 사례

1. AI를 첫 번째 단계로 사용하고 대체물로 사용하지 마세요

AI 코드 리뷰는 리뷰 프로세스의 첫 번째 단계여야 하며, 마지막 단계가 아닙니다. AI가 명백한 이슈(스타일, 잠재적 버그, 누락된 에러 처리)를 잡게 하여 인간 리뷰어가 설계, 아키텍처, 비즈니스 로직에 집중할 수 있게 하세요.

2. 코드베이스에 맞게 규칙을 커스터마이징하세요

모든 코드베이스에는 특정 컨벤션이 있습니다. 팀의 패턴을 반영하는 커스텀 규칙을 설정하는 데 시간을 투자하세요. 실제 표준을 적용하는 AI 리뷰어가 일반적인 조언을 주는 것보다 훨씬 가치 있습니다.

3. 리뷰어를 리뷰하세요

특히 처음 몇 주 동안은 AI 제안의 품질에 주의를 기울이세요. 관련 없는 제안은 무시하여 도구가 학습할 수 있게 하세요. 오탐을 표시하세요. 이 피드백 루프가 시간이 지남에 따라 도구의 정확성을 향상시킵니다.

4. PR을 작게 유지하세요

AI 코드 리뷰 도구는 집중적이고 작은 PR(400줄 미만의 변경)에서 가장 잘 작동합니다. 큰 PR은 AI와 인간 리뷰어 모두를 압도합니다. 팀이 큰 PR로 어려움을 겪는다면, AI 리뷰 피드백이 실제로 더 작고 빈번한 기여를 장려하는 데 도움이 될 수 있습니다.

5. 린팅 및 CI와 결합하세요

AI 코드 리뷰는 결정론적 도구를 보완하지만 대체하지 않습니다. CI에서 ESLint, Prettier, 타입 체킹, 테스트 스위트를 계속 사용하세요. AI가 정적 분석이 제공할 수 없는 세심한 제안을 처리하게 하세요.

6. 명확한 기대치를 설정하세요

AI 리뷰 코멘트가 명령이 아닌 제안임을 팀이 이해하도록 하세요. 개발자는 어떤 제안을 수락할지 판단해야 합니다. AI 피드백을 어떻게 처리해야 하는지에 대한 팀 합의를 만드세요.

워크플로 통합 예제

성숙한 팀이 AI 코드 리뷰를 워크플로에 통합하는 방법은 다음과 같습니다:

개발자가 PR을 엶

|

v

CI 실행 (린트, 타입, 테스트)

|

v

AI 리뷰 (CodeRabbit/Copilot)가 2-5분 내에 코멘트 게시

|

v

개발자가 AI 피드백을 반영하고 수정사항 푸시

|

v

인간 리뷰어 할당 (CODEOWNERS)

|

v

인간이 아키텍처, 로직, 나머지 AI 코멘트 리뷰

|

v

PR 승인 및 머지

이 워크플로는 인간 리뷰어가 AI 피드백을 기반으로 이미 정리된 PR을 받아 리뷰가 더 빠르고 상위 수준의 관심사에 더 집중할 수 있음을 의미합니다.

영향 측정하기

AI 코드 리뷰 도구에 대한 투자를 정당화하려면 다음 메트릭을 추적하세요:

| 메트릭 | 측정 대상 | 중요한 이유 |

|---|---|---|

| 첫 리뷰까지의 시간 | 첫 번째 리뷰 코멘트가 나타나는 속도 | 빠른 피드백이 개발자의 차단을 해제 |

| 리뷰 사이클 타임 | PR 오픈부터 머지까지의 시간 | 전체 리뷰 효율성 측정 |

| 리뷰에서 잡힌 버그 | 머지 전에 발견된 이슈 | 직접적인 품질 영향 |

| 리뷰어 시간 절약 | 시니어 개발자가 리뷰에 소비하는 시간 | 다른 작업을 위해 확보된 역량 |

| AI 제안 수락률 | AI 코멘트 중 변경으로 이어지는 비율 | 관련성과 정확성을 나타냄 |

대부분의 팀이 AI 코드 리뷰 도입 후 리뷰 사이클 타임이 30-50% 감소했다고 보고하며, 가장 큰 이득은 첫 번째 리뷰 단계에서 나타납니다.

결론

2026년의 AI 코드 리뷰 도구는 개발 팀에 실질적이고 측정 가능한 가치를 제공하는 수준의 성숙도에 도달했습니다. GitHub Copilot은 이미 GitHub 에코시스템에 있는 팀에게 가장 쉬운 선택입니다. CodeRabbit은 강력한 대화형 기능으로 가장 기능이 풍부한 전용 경험을 제공합니다. Sourcery는 리팩토링 제안과 코드 품질 메트릭에서 뛰어납니다. Qodo는 테스트 생성 기능으로 고유한 영역을 차지합니다.

대부분의 팀에 가장 좋은 접근 방식은 하나의 도구로 시작하여 특정 코드베이스에 맞게 설정하고, 피드백 품질에 따라 반복하는 것입니다. AI 코드 리뷰는 프로세스에서 인간의 판단을 제거하는 것이 아닙니다. 진정으로 인간의 통찰이 필요한 결정에 집중할 수 있도록 인간 리뷰어에게 더 나은 출발점을 제공하는 것입니다.

도구를 선택하고, 이번 주에 설정하고, 다음 한 달 동안 영향을 측정해 보세요. 생산성 향상은 실제적이고 즉각적입니다.